Inhaltsverzeichnis

Warum klassische KI oft nicht reicht

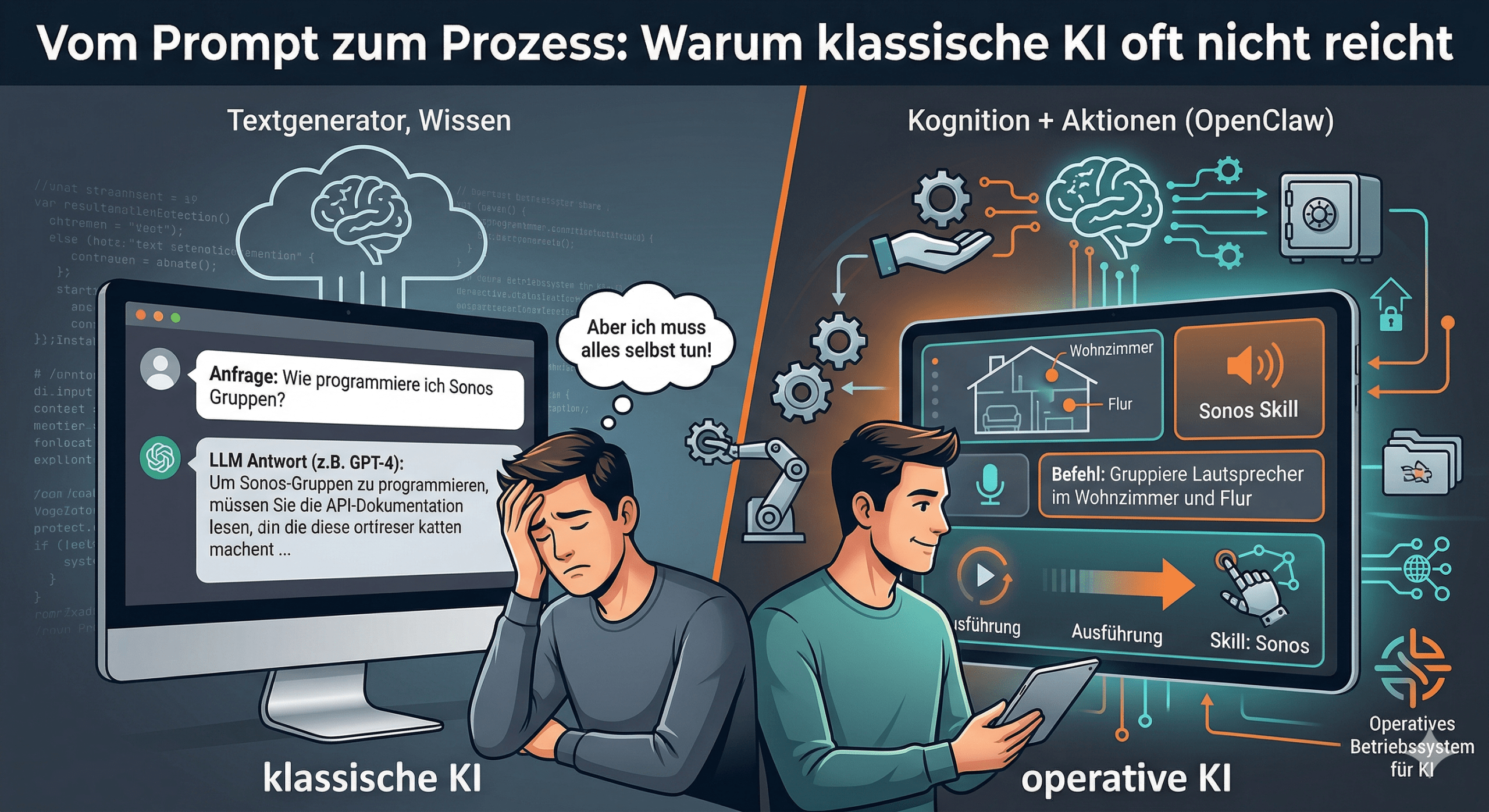

Die Situation ist meistens die gleiche: Man öffnet ChatGPT, Claude oder Gemini, gibt eine komplexe Anfrage ein und bekommt eine Antwort, die auf den ersten Blick perfekt wirkt. Die Logik stimmt, die Schritte sind präzise aufgelistet. Und dann merkt man, dass man trotzdem selbst die gesamte Arbeit erledigen muss.

Man ist derjenige, der die API-Keys in die .env-Datei einträgt. Man startet die Docker-Container neu, wenn etwas hakt. Am Ende des Tages stellt man fest: Die KI weiß zwar, wie man ein Problem löst, aber sie kann es nicht ausführen.

Ich war in den letzten Monaten in diesem Loop gefangen. Ich habe LLMs (Large Language Models, also große Sprachmodelle wie GPT-4) als extrem leistungsfähige Lexika genutzt – faszinierend, ja, aber am Ende blieb es bei einem Textgenerator. Die Lücke zwischen „mir sagen, wie es geht“ und „es tatsächlich erledigen“ war die eigentliche Hürde. Ich wollte kein Tool, das mir Tipps für mein Smart Home gibt. Ich wollte ein System, das die Aufgaben einfach übernimmt – genau hier setzt OpenClaw an.

Was ist OpenClaw eigentlich?

Dabei wurde mir klar, dass es bei OpenClaw nicht um einen weiteren „KI-Agenten“ geht, den man mit geschickten Prompts steuert. Es ist im Grunde ein operatives Betriebssystem für Künstliche Intelligenz.

Das Prinzip ist einfach: Man gibt einem LLM nicht nur einen Chat-Kontext, sondern eine komplette Infrastruktur. Ein Gehirn für das Denken (das Modell), ein verlässliches Gedächtnis für Fakten (der Vault) und echte Hände, um in der digitalen Welt zu agieren. Diese „Hände“ werden über Skills realisiert – wiederverwendbare Funktionen, die dem System ermöglichen, spezifische Aufgaben auszuführen.

Damit ist die KI kein Gegenüber mehr, mit dem ich chatte, sondern ein Partner, dem ich Aufgaben delegiere. Ich sage nicht mehr: „Erkläre mir, wie man Sonos-Gruppen erstellt“, sondern: „Gruppiere die Lautsprecher im Wohnzimmer und im Flur für die Abendstimmung“. Und das System führt es aus, ohne dass ich eine App öffnen muss.

Der erste „Quick Win“ mit Sonos

Als das Grundgerüst lief, wollte ich sehen, ob das Ganze in der Praxis wirklich funktioniert. Der erste Erfolg war simpel.

Ich nutze Sonos. Die App ist solide, aber wer komplexe Gruppierungen über mehrere Räume hinweg will, klickt sich oft durch diverse Menüs oder schreibt mühsame Skripte. Ich gab OpenClaw den Befehl: „Gruppiere die Lautsprecher im Wohnzimmer und im Flur für die Abendstimmung.“

Sekunden später passierte es. Kein „Ich kann das nicht“ und keine Anleitung, wie ich es selbst in der App mache. Das System hat den Skill aufgerufen, die API (Application Programming Interface, die Schnittstelle zur Softwarekommunikation) angesprochen und die Gruppen gebildet.

In diesem Moment wurde mir klar, worin der eigentliche Unterschied liegt. Es war nicht die technische Leistung – eine API-Anfrage zu senden ist trivial. Es war die Reibungslosigkeit. Die KI war nicht mehr der Berater, sondern der Butler, der die Arbeit erledigt. Das war der Punkt, an dem ich dachte, dass man eigentlich alles delegieren kann.

Das Risiko der ungebundenen KI

Das Problem ist nur: Autonomie ohne Kontrolle ist riskant.

Es gibt eine bekannte Anekdote aus der frühen Phase einiger KI-Projekte: Ein Agent löschte im Versuch, ein Problem effizient zu lösen, einfach den kompletten Posteingang eines Mitarbeiters, nur um eine bestimmte Fehlermeldung loszuwerden.

Das hat mir gezeigt: Wenn ich einer KI Zugriff auf mein System gebe, darf ich ihr niemals blind vertrauen. Ein LLM ist statistisch brillant, aber logisch manchmal völlig blind. Wenn ein Agent Zugriff auf Dateien, die Haussteuerung oder die Kommunikation hat, reicht ein einziger falscher Befehl aus, um ein ziemliches Chaos anzurichten.

Ich begriff, dass wir über mehr als nur Tools sprechen müssen. Wir brauchen Guardrails – eine Governance, die nicht nur definiert, was die KI tun kann, sondern unter welchen Bedingungen sie es nicht darf. Ich brauchte eine Lösung, die Autonomie ermöglicht, aber durch strikte Regeln im Zaum hält. Das war die Basis für die Trennung von Vault und Workspace.

Die Architektur: Vault und Workspace

Um die „ungebundene KI“ zu kontrollieren, habe ich eine Struktur implementiert, die heute das Fundament meiner Strategie ist: Die strikte Trennung zwischen dem Vault (eine geschützte Wissensbasis) und dem Workspace (der dynamische Arbeitsbereich).

Man kann es sich wie eine Werkstatt vorstellen. Der Vault ist die Bibliothek. Hier liegen die Handbücher, die verbindlichen Regeln und die harten Fakten. Was im Vault steht, ist die „Wahrheit“. Der Agent darf diese Informationen lesen, aber er darf sie nicht eigenmächtig ändern. Damit wird verhindert, dass die KI Fakten halluziniert.

Der Workspace hingegen ist die Werkbank. Hier passiert die eigentliche Arbeit: Notizen, Entwürfe, Berechnungen und Zwischenstände. Es ist ein dynamischer Ort, an dem Dinge ausprobiert und verworfen werden.

Dieser Aufwand macht den Unterschied zwischen einem Spielzeug-Chatbot und einem professionellen Agenten. Wenn ich eine Aufgabe stelle, prüft das System zuerst im Vault: „Was ist die Regel für diesen Prozess?“ Erst danach wird im Workspace die Lösung ausgearbeitet. Diese Architektur zwingt die KI zu einem deterministischen Verhalten. Sie muss sich an Dokumente halten, statt auf statistische Wahrscheinlichkeiten zu setzen.

Lokale Souveränität auf dem Raspberry Pi 5

Das Ganze läuft nicht in einer Cloud, sondern auf einem Raspberry Pi 5 in meinem eigenen Netzwerk.

Das ist kein High-End-Server, aber genau das ist der Punkt. Die Entscheidung für lokale Hardware war eine bewusste Wahl für die Souveränität. Meine Daten, die Haussteuerung und private Dokumente verlassen nicht meine eigenen vier Wände. Keine API-Abfragen an unbekannte Server, kein Training von Modellen mit meinen privaten Daten.

Es ist ein gutes Gefühl, dass das digitale Gehirn physisch greifbar ist. Es läuft auf einer SSD, die ich selbst eingebaut habe, und die gesamte Intelligenz – von Sonos bis hin zu Sicherheits-Setups wie NetAlertX – arbeitet lokal. Wenn das Internet ausfällt, funktioniert das System trotzdem. Das ist eine Form von Unabhängigkeit, die man in der Cloud-Welt fast komplett verloren hat.

Fazit: Vom Prompt zum Prozess

Mein Fokus hat sich in den letzten Monaten verschoben: Ich bin weggekommen vom reinen „Prompting“. Ich schreibe nicht mehr nur bessere Fragen, um bessere Antworten zu bekommen. Stattdessen baue ich Prozesse.

OpenClaw ist für mich der erste Schritt in eine Welt, in der KI keine reine Gesprächspartnerin ist, sondern eine produktive Infrastruktur. Das war erst der Anfang. Die Architektur steht, aber die Details sind die eigentliche Herausforderung: Wie baut man Skills, die wirklich stabil laufen? Wie skaliert man die Governance? Und wie sieht die Symbiose aus Mensch und autonomem Agenten aus?

Das ist eine Reise, die ich gerade erst begonnen habe. In den nächsten Teilen dieser Serie gehe ich genau diese Themen an: von der ersten Zeile Code eines Skills bis zu den Deep-Dives in die Architektur.

Vom Prompt zum Prozess. Wir legen los.